Effiziente Abläufe, Prozesstransparenz und Risikoerkennung sind der Schlüsselfaktor für eine erfolgreiche Organisation. Nicht ohne Grund beschäftigen größere Unternehmen eigene Abteilungen mit dem Auftrag zur Prozessoptimierung und der Revision. Die komplette Prozesskette – z. B. im Einkauf von der Bedarfsentstehung bis zur Zahlung – ist auf operativer und strategischer Arbeitsebene regelmäßig zu hinterfragen. Infolge der erhöhten Unterstützung der Prozessverarbeitung durch ERP– und andere IT-Systeme sowie der steigenden Abhängigkeiten inner- und außerbetrieblicher Prozesse, nimmt der Aufwand für das Monitoring von Geschäftsprozessen rasant zu.

Prozessgestaltung

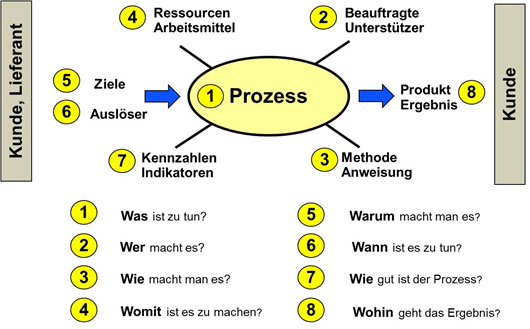

Funktion und Nutzen des Turtle-Models (8W-Modell)

Erfolgreiche Unternehmen versuchen Probleme zu identifizieren und zu lösen, solange sie noch klein sind und beschäftigen sich demzufolge nicht nur mit Symptomen und Kennzahlen, sondern auch mit ihnen zugrunde liegenden Ursache-Wirkungsketten.

Die Beschreibung von Prozessen und deren Darstellung in Prozessmodellen erfolgt bei Unternehmen häufig aufgrund von Kundenanforderungen oder externen Regelwerken, um die Schlüssigkeit der Unternehmensorganisation und Reproduzierbarkeit von Abläufen nach außen hin glaubhaft darzustellen.

Wesentlicher Treiber ist dabei der Nachweis der Qualitätsfähigkeit innerhalb einer Kunden-Lieferantenbeziehung oder der Nachweis der Erfüllung obligatorischer organisatorischer Sorgfaltspflichten.

Intern ist ein Führen mit Kennzahlen oder das Gestalten von Veränderungen im Unternehmen nur sehr eingeschränkt möglich, wenn es für wesentliche Geschäftsprozesse mehr informelle Regelungen als nachprüfbar dokumentierte Standards gibt.

Zur Planung, Beschreibung und Analyse von Prozessen haben sich in der Praxis eine Reihe von Vorgehensmöglichkeiten entwickelt, die je nach Zielstellung ausgewählte kritische Teilprozesse betrachten oder zusammenhängende Prozessketten, die z. B. Grundlage für eine Prozess-Simulation oder Prozesskostenrechnung sein können.

Notwendige Projekterfahrung im Geschäftsprozessmanagement oder die Komplexität verfügbarer IT Lösungen setzen in der Praxis den meisten Unternehmen jedoch Grenzen.

Für die einfache Darstellung und Analyse von Prozessen hat sich insbesondere im Bereich Automotive überwiegend das Turtle-Model (oder auch 8W-Modell) etabliert. Der Name Turtle rührt von der oft skizzierten Form einer Schildkröte her, wo Maul und Schwanz jeweils (Prozess-) Input und Output sowie die Gliedmaßen bestimmte Einflussfaktoren symbolisieren.

Die in klassischen Organigrammen und Prozessbeschreibungen zu findende Frage nach dem wer macht was wird beim Turtle-Model um das warum, wann, womit, wie, wohin und wie gut für jeden einzelnen Prozess-Schritt erweitert. Die Notwendigkeit einzelner Prozess-Schritte kann damit genau so kritisch betrachtet werden wie Unsicherheiten oder Unklarheiten bei der Regelung erfolgskritischer Details.

Industrie 4.0 – Konzepte und Herausforderungen

Das Zukunftsprojekt Industrie 4.0 wird unsere Industrie verändern. Produktions- und Lieferzeiten werden durch intelligente Steuerung verkürzt und hinsichtlich des Ressourceneinsatzes optimiert werden. Die virtuelle Realität wird Produkte von noch besserer Qualität schaffen, bei kostengünstigerer Produktentwicklung, die näher an die Fertigungsprozesse rücken wird. Durch das Internet der Dinge wird die Produktion und Logistik zuverlässiger sowie für Kunden transparenter werden. Insgesamt wird die Industrie 4.0 anders als die vorangegangenen Industrierevolutionen nicht nur insgesamt die Produktivität, sondern vor allem die Flexibilität erhöhen, bis hin zur kundenindividuellen Massenproduktion.

Die Fabrik 4.0 soll…

- sich selbst digital abbilden und simulieren können und gleichzeitig möglichst mit der Realität verschmelzen,

- Produktionssysteme, Produkte und Dienste mit Informationen ausstatten und miteinander kommunizieren lassen,

- durch Datenanalysen in ihrer Situation aufgenommen, überwacht und im Generellen optimiert werden,

- sich darauf aufbauend durch künstliche Intelligenz selbst steuern und im Speziellen auch selbst optimieren können.

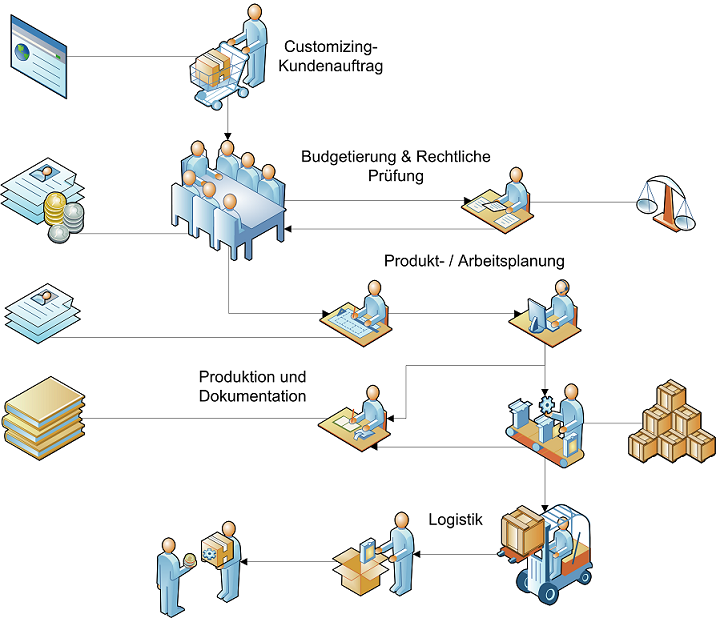

Workflowmanagement -Systeme

Das Workflowmanagement (zu Deutsch etwa: Verwaltung von Arbeitsabläufen) steht dem (Geschäfts-)Prozessmanagement sehr nahe. Ziel des Workflowmanagements ist die Koordination von Prozessen über Workflowmanagementsysteme, indem sie die Ausführungsreihenfolge der Prozesse oder der Aktivitäten von Prozessen überwachen, Daten für die Ausführung von Aktivitäten bereitstellen, anstehende Aktivitäten menschlichen oder technischen Bearbeitern zur Ausführung zuordnen und Anwendungssysteme für die Bearbeitung zur Verfügung stellen.

Während die Steigerung der Produktivität im Produktionsbereich durch Prozessmanagement bereits früh erschlossen wurde, blieben Produktivitätssteigerungen im Bürobereich verhältnismäßig lange aus. In den 1980er Jahren begann sich mit der Office Automation und dem Ziel der computergesteuerten Durchführung wiederkehrender Vorgänge auch im Bereich der Büroarbeit Prozessmanagement durchzusetzen. Workflowmanagement ist jedoch nicht nur eine Büroangelegenheit, sondern dringt auch bis tief in die Produktionsplanung und -steuerung vor. Beispielsweise sind Stücklisten, Arbeitspläne, Produktionspläne usw. Arbeitsmittel und Kommunikationsmittel zwischen der Logistik- bzw. Produktionsplanung/-steuerung, die überwiegend als Bürotätigkeit geschieht, und der ausführenden Produktion. Auch die Erfassung der Arbeitszeiten und -tätigkeiten findet zwischen der Personalwirtschaft/Buchhaltung und der Produktion statt. Wann welche Arbeitsmitteln an welchem Ort bzw. bei welcher Person sein müssen und wer wann und wo welche Arbeitsschritte auszuführen hat, entscheiden Workflowmanagementsysteme.

Prozessmanagement – Buchempfehlung

Prozessmanagement gilt seit der 90er Jahre als unverzichtbare Maxime in der Unternehmensgestaltung. Das Geschäftsprozessmanagement ist heute zu einem entscheidenden Instrument der Führung und Gestaltung von Unternehmen geworden. Der stetige Kostendruck in allen Branchen und die steigende Nachfrage nach individuellen Produkten bedingen zunehmend strategische Entscheidungen, wie die enge Integration und Kooperation mit Partnern, Kunden und Lieferanten sowie eine prozessorientierte Analyse und Realisierung von Organisations- und IT-Strukturen.

Aufbauorganisation folgt Ablauforganisation – Auf dieses Ideal stoßen Studenten des Wirtschaftsingenieurwesens immer wieder und auch das Buch Prozessmanagement – Ein Leitfaden zur prozessorientierten Organisationsgestaltung von den Autoren Jörg Becker, Martin Kugeler und Miacheal Rosemann (Hrsg.) bekräftigt dies mit jedem der 21 Kapitel. Das Buch ist eines der umfangreichsten Werke über das moderne Prozessmanagement.

Prozessmanagement: Ein Leitfaden zur prozessorientierten Organisationsgestaltung

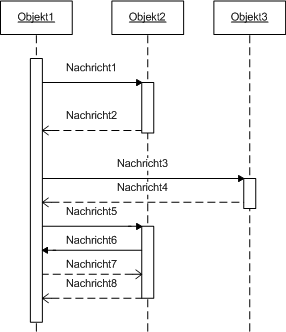

Sequenzdiagramm

Sequenzdiagramme gehören zur UML und sind in der Prozessmodellierung sowie in der Software-Entwicklung zur Darstellung der Interaktion von Objekten untereinander sehr verbreitet. In der Prozessmodellierung stellen Sequenzdiagramme die Interaktionen zwischen Akteuren und dem Geschäftssystem dar. Als Modellierungssprache sind Sequenzdiagramme insbesondere in der Informatik bzw. Wirtschaftsinformatik verbreitet. Die gegenseitigen Abhängigkeiten, Aufrufhierarchien und Lebenszeiten von Objekten können einem Sequenzdiagramm leicht verständlich entnommen werden. Sequenzdiagramme zeigen:

- Abhängigkeiten: Welche Objekte interagieren mit welchen anderen Objekten?

- Aufrufhierarchie: Welche Objekte rufen das Objekt auf und welche werden vom Objekt aufgerufen?

- Lebenszeiten: Wie lange existieren Objekte bzw. wie lange werden Objekte benötigt?

- Aktivitätszeiten: Wie lange sind Objekte aktiv?

Sequenzdiagramme werden immer von einem Akteur (Benutzer / User) oder einem Objekt begonnen. In einem Gesamtsystem gibt es für jeden Akteur in einem Anwendungsfalldiagramm ein eigenes Sequenzdiagramm.

MTM – Universelles Analysier System

MTM steht für Methods-Time Measurement und gilt heute als Maßstab mit international anerkannten Standards für die Optimierung von Prozessen, insbesondere in der Fertigung und Montage. Das MTM-Grundsystem (MTM-1) hat seinen Ursprung in der Industrialisierung und wurde für die Bedürfnisse in der Massen- und Großserienfertigung entwickelt.

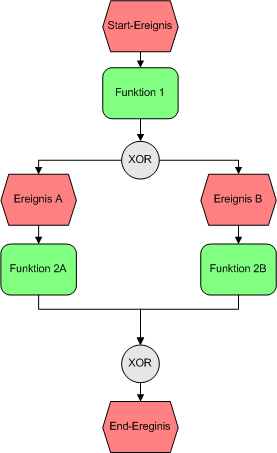

Ereignisgesteuerte Prozesskette – EPK

Die Ereignisgesteuerte Prozesskette (EPK, engl.: Event-driven Process Chain – EPC) ist als ein Bestandteil der Architektur integrierter Informationssysteme (ARIS) eine international sehr bekannte Methode der Prozessdarstellung. Ereignisgesteuerte Prozessketten sind Bedingungs-Ereignisnetze aus der Petri-Netz-Theorie.

Objektorientierung

Mit der Objektorientierung werden einzelne Sachverhalte nicht mehr nur auf ihrer Einzelteile reduziert, sondern das integrierte Ganze im Zusammenhang – mit allen Verbindungen und Abhängigkeiten – wird betrachtet.

Objektorientiertes Modellieren

Programmablaufpläne (PAP), Struktogramme oder Ereignisgesteuerte Prozessketten (EPK) sind typische Modellierungsinstrumente in der Prozessgestaltung. Diese Darstellungsformen sind jedoch nicht objekt-, sondern rein prozessorientiert. Objektorientierte Modellierung bedeutet, nicht nur Daten und Funktionen zu beschreiben, sondern auch die Beziehungen und Strukturen von Klassen bzw. Objekten zu berücksichtigen. Als eine sehr objektorientierte Modellierungssprache gilt die UML.

Objektorientierte Programmierung

Die objektorientierte Programmierung ist aus der heutigen Software-Entwicklung nicht mehr weg zu denken. Die meisten relevanten Hochsprachen unter den Programmiersprachen erlauben oder erzwingen eine ganz oder teilweise objektorientierte Programmierung. Die ersten erfolgreichen Programmiersprachen, wie beispielsweise Assembler, C oder Basic, waren rein prozessorientiert nach Ablaufschemen, welche oftmals auf Programmablaufplänen oder Struktogrammen basieren. Die Programmiersprache C ist auch heute noch aktuell, wenn auch nicht mehr für allgemeine Anwendungsprogramme, sondern für eingebettete Systeme (Embedded Systems), also die Mikrocontroller-Programmierung.